Det mobila operativsystemet iOS 13 har också en mycket intressant funktion som gör att applikationer kan ta olika bilder från olika kameror på samma enhet, inklusive ljud.

Något liknande har fungerat på Mac sedan OS X Lions dagar. Men hittills har den begränsade prestandan hos mobil hårdvara inte tillåtit detta. Men med den senaste generationen iPhones och iPads faller även detta hinder, och iOS 13 kan därför spela in samtidigt från flera kameror på en enhet.

Det kan vara intresserar dig

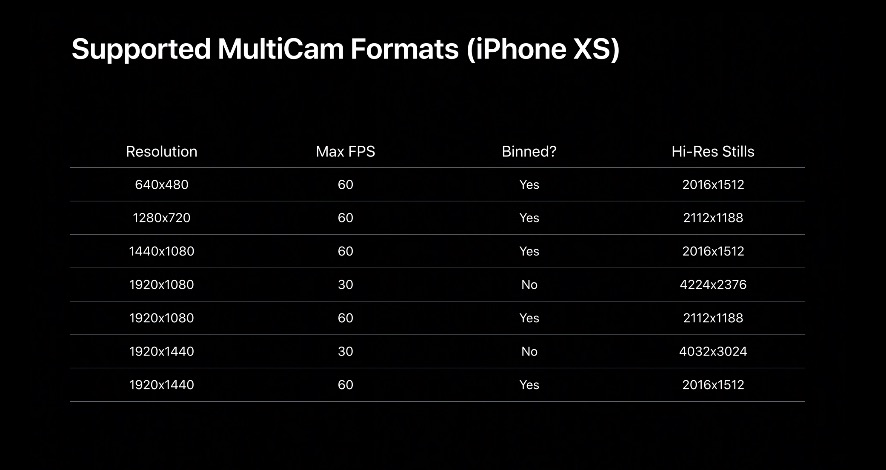

Tack vare det nya API:et kommer utvecklare att kunna välja från vilken kamera applikationen tar vilken ingång. Med andra ord kan den främre kameran till exempel spela in video medan den bakre kameran tar bilder. Det gäller även ljud.

En del av presentationen på WWDC 2019 var en demonstration av hur en applikation kan använda flera poster. Applikationen kommer alltså att kunna spela in användaren och samtidigt spela in bakgrunden av scenen med den bakre kameran.

Samtidig inspelning av flera kameror endast på nya enheter

I Photos-applikationen var det sedan möjligt att helt enkelt byta båda skivorna under uppspelning. Dessutom kommer utvecklare att få tillgång till de främre TrueDepth-kamerorna på de nya iPhones eller vidvinkel- eller teleobjektivet på baksidan.

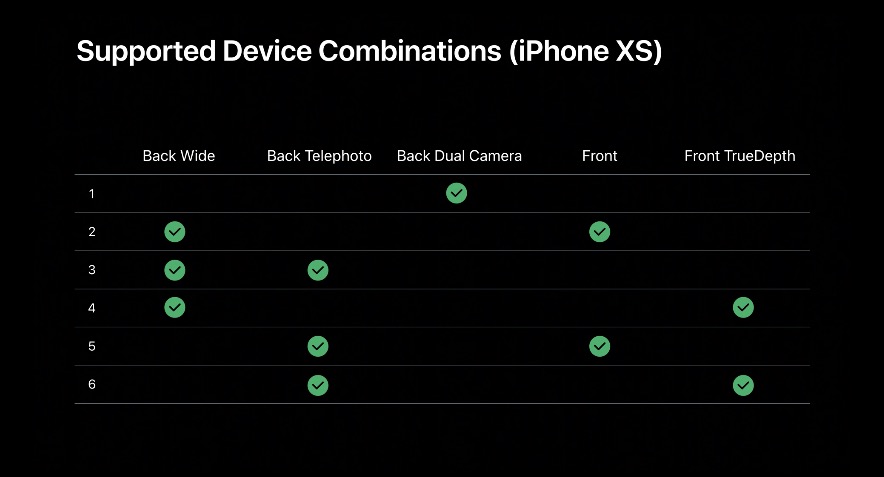

Detta för oss till den begränsning som funktionen kommer att ha. För närvarande stöds endast iPhone XS, XS Max, XR och den nya iPad Pro. Inga andra enheter är nya funktion i iOS 13 de kan inte använda det än och kommer förmodligen inte att kunna det heller.

Dessutom har Apple publicerat listor över kombinationer som stöds. Vid närmare granskning kan man dra slutsatsen att vissa begränsningar inte är så mycket av hårdvarukaraktär som av mjukvarukaraktär, och Cupertino blockerar medvetet åtkomst på vissa ställen.

På grund av batterikapaciteten kommer iPhones och iPads bara att kunna använda en kanal med flerkameror. Tvärtom, Mac har ingen sådan begränsning, inte ens bärbara MacBooks. Dessutom kommer den utvalda funktionen förmodligen inte ens att vara en del av systemkameraappen.

En utvecklares fantasi

Huvudrollen kommer därför att vara utvecklarnas färdigheter och deras fantasi. Apple har visat en sak till, och det är den semantiska igenkänningen av bildsegment. Inget annat döljer sig under denna term än förmågan att känna igen en figur i en bild, dess hud, hår, tänder och ögon. Tack vare dessa automatiskt detekterade områden kan utvecklare sedan tilldela olika delar av koden, och därmed funktioner.

Det kan vara intresserar dig

På WWDC 2019-workshopen presenterades en applikation som filmade bakgrunden (cirkus, bakre kamera) parallellt med karaktärens rörelse (användare, främre kamera) och kunde ställa in färgen på huden som en clown med hjälp av semantiska regioner .

Så vi kan bara se fram emot hur utvecklarna kommer att ta till sig den nya funktionen.

källa: 9to5Mac